Ещё весной я радовался выходу языковой модели LLama 3, которая, казалось бы, должна была стать той самой «домашней»

Потом сообщество стало доводить её до ума, расширять контекст, учить лучшему пониманию русского языка и т.д. Для бесплатного и такого, что вполне себе работает на какой-нибудь RTX 3060 — уже хорошо. Пока я сидел себе, придумывал какие задачи ей поручать и прочее вышла Gemma 2 от Google, которая чуть лучше. И снова пошёл цикл ожидания прикосновения напильника энтузиастов, тестирование и «Во, теперь классно. Давай куда-то внедрять». Где-то рядом Mistral и другие, которые могут быть лучше заточены под что-то конкретное (например, программирование).

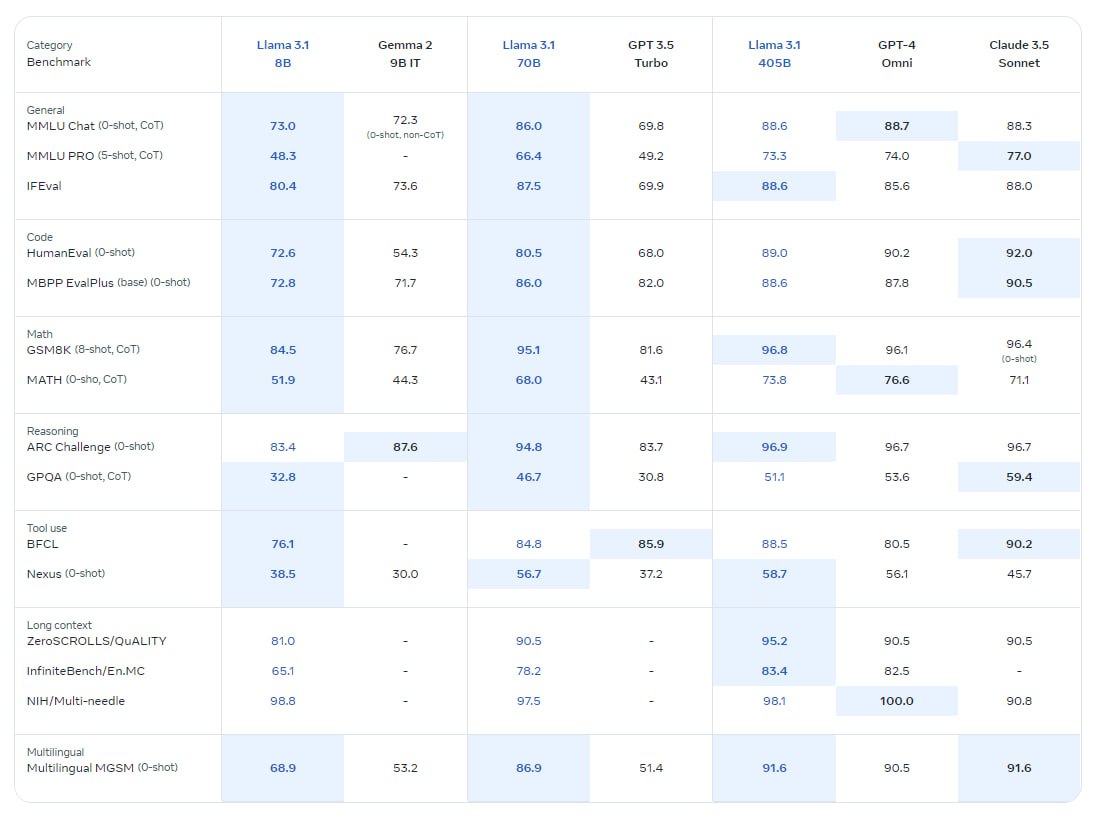

А в конце Июля нам представляют LLama 3.1, которая в разных категориях становится интересным вариантом. Как в домашнем варианте с 8B параметров, так и совсем злое на 405В, чтоб тягаться с лучшим и проприетарным. Снова что-то чуть лучше, контекстное окно побольше, снова ждать пока сумеет в достойный русский язык и с меньшим количеством ограничений. На короткой дистанции в несколько месяцев не так заметен прогресс, но оглянувшись хотя бы в пару лет уже чувствуется.

Но конкуренция за наши деньги она не только здесь. Интересное происходит и у API-провайдеров, которые предоставляют доступ к моделям.

Как это примерно работает. Если у вас очень простые персональные задачи — вы идёте на проприетарный сервис. Если вы эту модель куда-то интегрируете или собираетесь использовать через свой софт — берёте модель по API, платите за токены входа/выхода и получаете доступ к языковым моделям без необходимости их развертывания и обслуживания.

Примером такого использования может быть какой-нибудь чат-бот для Авито, который отвечает на типичные вопросы покупателей, предоставляет информацию о товарах/услугах, ведёт базовые переговоры. В таком случае самую злую, дорогую и навороченную модель не нужно.

Этот API-доступ предоставляют не только сами разработчики моделей, но и третьи компании. Например, OpenAI предлагает доступ к GPT через свое API, а компания Anthropic — к модели Claude. При этом есть агрегаторы вроде openrouter.ai , fireworks.ai, groq.com и тому подобные, которые дают доступ сразу к нескольким моделям через единый интерфейс. Да, рейтинги провайдеров тоже есть. И все конкурируют друг с дружкой.

GPT 4o-mini от OpenAI приходит стать ещё более быстрой и дешевой, чем GPT 3.5, чтобы уделать своих конкурентов, потом ты идёшь искать у какого посредника что тебе дешевле обойдётся и выбираешь решение под свои задачи. На нашем рынке за API-доступом к языковым моделям можно идти в Яндекс или Сбер, ну или к местным перекупам, которые примут оплату за рубли.

Для энтузиастов и компаний, которые хотят больше контроля, есть вариант развернуть открытые модели на собственном оборудовании. Это требует мощных GPU, но позволяет полностью контролировать процесс и данные. Например, можно развернуть ту же LLama на домашнем или корпоративном сервере с достаточным количеством GPU и получать API-доступ но уже со своего сервера.

Выбор между проприетарным сервисом, API-доступом или собственным развертыванием свободных моделей зависит от конкретных задач, бюджета и требований к безопасности. Для простых персональных задач удобнее использовать готовые сервисы. Для интеграции в собственные продукты и продвинутого персонального использования оптимальным может быть API-доступ. Если ты что-то большое с кучей требований и закрытым контуром…ну, вы поняли.

Энивей, языковые модели (и проприетарные, и открытые) продолжают становиться лучше, быстрее и дешевле. А покупать доступ к обеим категориями мы ходим к API-провайдерам, которые становятся дешевле. Тем интереснее.

t.me/staniverse/133* · 25 июл 2024*